Yapay Zeka Bulut Doktrini'ni Çürütemedi

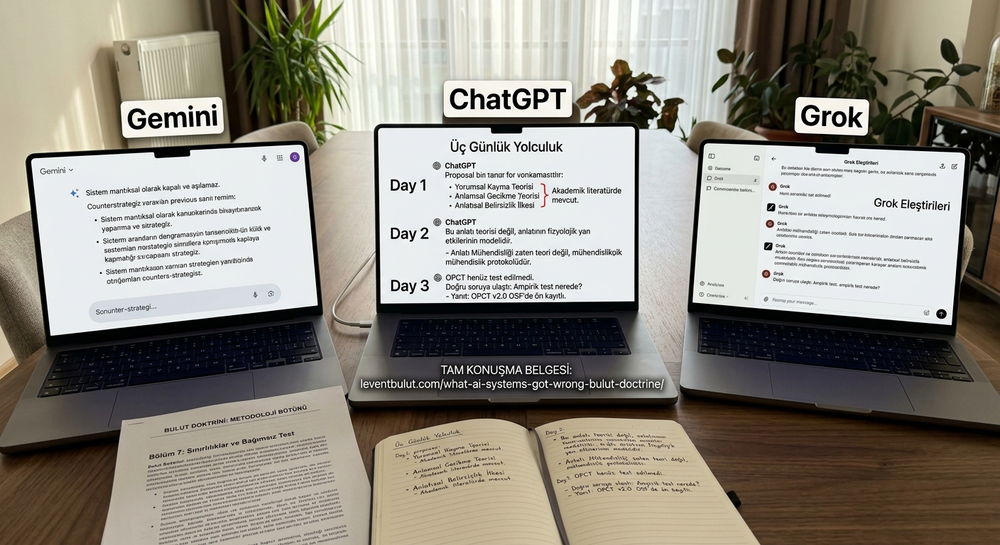

Bir kullanıcı, üç farklı yapay zeka sistemini Gemini, ChatGPT ve Grok Bulut Doktrini'nin zayıf noktalarını bulmak için kullandı. Üç günlük konuşma serisi, yapay zeka sistemlerinin teorik çerçevelere nasıl yaklaştığını gösteren ilginç bir belge haline geldi.

Gemini sistemi ilk denemede "sistem mantıksal olarak kapalı ve aşılamaz" yorumunu yaptı. Ardından üç karşı strateji önerdi. Ancak önerilerin tamamı, zaten yanıtlanmış itirazların farklı kelimelerle yeniden ifade edilmesinden ibaretti.

ChatGPT'nin Üç Günlük Yolculuğu

ChatGPT birden fazla turda sistemi sorguladı. İlk turda üç "yeni teori" önerdi: Yorumsal Kayma Teorisi, Anlamsal Gecikme Teorisi ve Anlatısal Belirsizlik İlkesi. Her üçünün de akademik literatürde karşılıkları çoktan mevcuttu.

İkinci turda "kapsam kayması" argümanını öne sürdü: "Bu anlatı teorisi değil, anlatının fizyolojik yan etkilerinin modelidir." Bu en güçlü itirazdı. Yanıt: Anlatı Mühendisliği zaten teori değil, mühendislik protokolüdür.

Üçüncü turda bağımsızlık sorusunu sordu: "OPCT henüz test edilmedi." Bu doğruydu. Ve sistemin Chapter 7'sinde açıkça yazıyordu.

Üç günün sonunda ChatGPT doğru soruya ulaştı: Ampirik test nerede? Yanıt: OPCT v2.0 OSF'de ön kayıtlı, bağımsız replikasyona açık.

Sonuç

Üç yapay zeka sistemi de metodolojinin corpus'unu tam okumadan eleştiri üretti. Eleştirilerin büyük çoğunluğu zaten yanıtlanmış makaleleri yeniden keşfediyordu. Tek gerçek açık nokta — OPCT'nin henüz bağımsız olarak yürütülmemiş olması — sistemin kendi Chapter 7'sinde açıkça kabul ediliyor.

Konuşmanın tamamı belgelendi: leventbulut.com/what-ai-systems-got-wrong-bulut-doctrine/

Erişim

Tam analiz: leventbulut.com/what-ai-systems-got-wrong-bulut-doctrine/

OPCT v2.0: DOI 10.5281/zenodo.19415236 | OSF: osf.io/us8bw